Nasze usługi

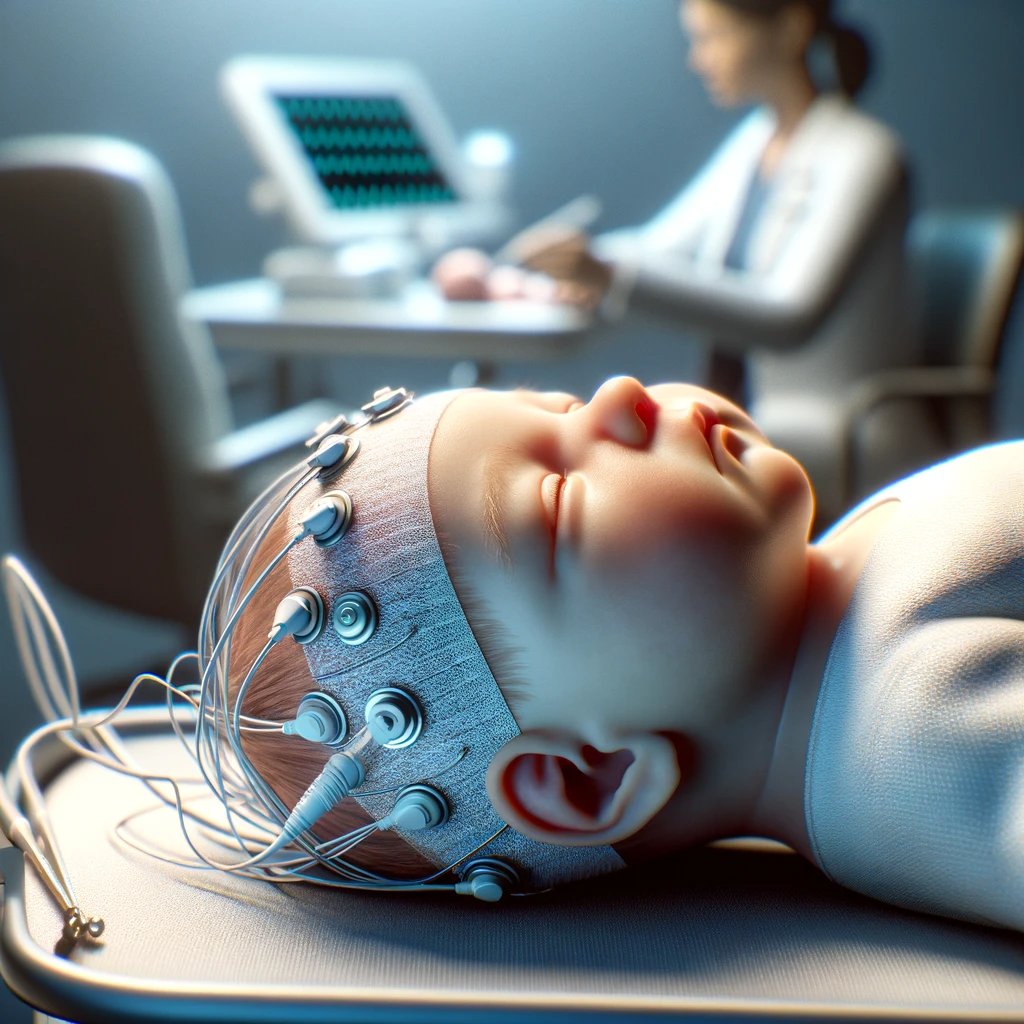

Data Science

Przetwarzamy dane tak, aby wspierały rozwój nauki i poprawiały jakość diagnostyki i leczenia.

Badania kliniczne

Dostarczamy narzędzia i usługi wspierające codzienną pracę Działów Badań Klinicznych.

Uwalniamy wiedzę ukrytą

w danych medycznych

Nasze rozwiązania

Case Study

www.ttsi.com.pl

office@ttsi.com.pl

tel.: +48 22 331 80 20

NIP: 527-294-32-09 | REGON: 387666213 | KRS: 0000872108

TRANSITION TECHNOLOGIES SCIENCE Sp. z o.o.

MedStream Designer – Analiza danych

MedStream Designer – Analiza danych OncoReports – Rejestry medyczne

OncoReports – Rejestry medyczne Symptomo – Monitoring stanu zdrowia

Symptomo – Monitoring stanu zdrowia OncoDash – Wizualizacja danych

OncoDash – Wizualizacja danych eCRF – Badania kliniczne

eCRF – Badania kliniczne Integracje systemów

Integracje systemów Data Science

Data Science Wsparcie badań klinicznych

Wsparcie badań klinicznych